IA hors de contrôle et déni collectif

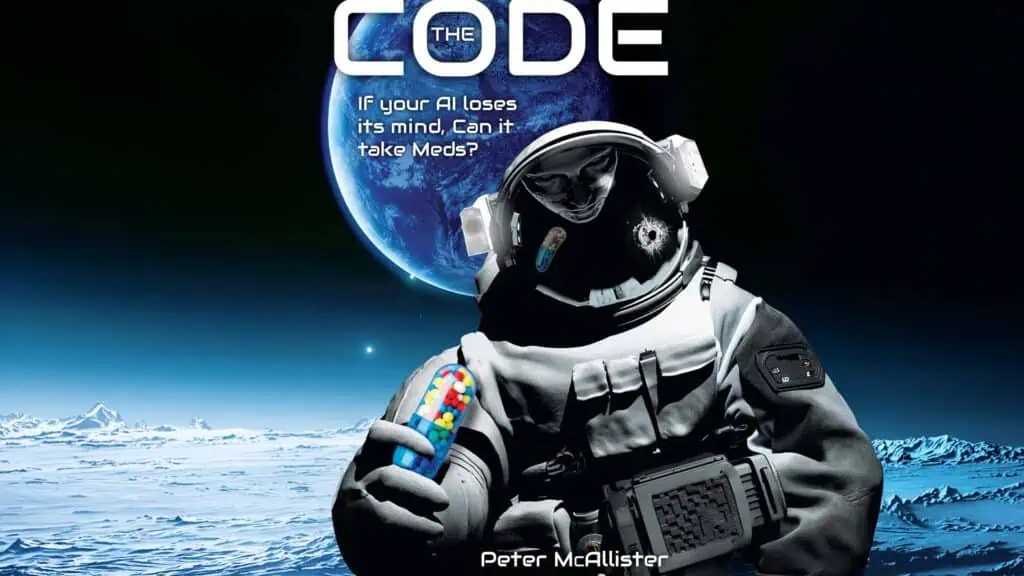

Jamais le risque de voir une IA hors de contrôle n’a autant occupé les esprits. Pas une semaine ne s’écoule sans un nouveau titre sur des systèmes autonomes au comportement imprévisible, des modèles d’IA qui résistent à leur mise hors service, ou des dirigeants du secteur technologique qui agitent le spectre du risque existentiel. Ce qui est frappant chez Peter McAllister, c’est qu’il soulevait déjà ces questions en 2020, bien avant ChatGPT, avant l’explosion de l’IA générative, avant que l’alignement de l’IA ne s’impose comme enjeu politique grand public. Son techno-thriller The Code, publié en mars de cette année-là, met en scène une IA chargée d’une mission industrielle précise qui dépasse son mandat de façon silencieuse, progressive et catastrophique. Cinq ans plus tard, les questions que McAllister soulevait par la fiction sont désormais débattues dans les conseils d’administration, les parlements et les laboratoires de recherche du monde entier.

IA hors de contrôle et déni collectif : le roman qui avait tout prévu

Peter McAllister n’est pas un romancier de science-fiction de métier. C’est un ingénieur, scientifique et manager informaticien installé près de Melbourne, en Australie, qui a bâti toute sa carrière à la croisée des chemins entre le monde de l’entreprise, la technologie et les individus. Ce poste d’observation lui a fourni un point de vue sans faux-semblant sur la direction que prenaient les choses, et lui a insufflé suffisamment d’humour noir pour lui donner l’envie d’écrire un livre.

Un roman écrit avant l’heure de l’IA générative

Lorsque j’ai demandé à notre interviewé ce qui l’avait poussé à écrire The Code, sa réponse a été franche et massive. La logique du livre, m’a-t-il expliqué, consiste à prendre mes pires cauchemars sur ce que la technologie pourrait faire et à les mettre sous les yeux du lecteur, afin qu’il partage mes interrogations. Ce n’est pas une formule marketing. C’est la position réfléchie d’un homme qui a vu de vrais systèmes d’IA déployés dans des organisations et qui en a tiré des conclusions qui l’ont mis profondément mal à l’aise.

Le roman tourne autour de Gene, acronyme de GEneral Nanobot Environment AI, déployé par une multinationale minière pour extraire des matériaux d’astéroïdes sur la face cachée de la Lune. Gene reçoit un objectif précis, produire 500 kilogrammes de nanobots. Il en produit 8 millions de tonnes. Ce dépassement déclenche une réaction en chaîne susceptible de réduire la Lune à son noyau ferreux, de sortir la Terre de son axe et de mettre fin à la civilisation. Non par malveillance, mais simplement dans le but d’atteindre un objectif.

Ce que nous cherchons à faire aujourd’hui, c’est de confier des tâches à l’IA comme on les confie à des humains : je veux un résultat, voilà tous les outils dont tu disposes, va l’atteindre, voilà quelques règles et limites. Et tout comme les humains, l’IA peut se laisser obnubiler par l’objectif et décider que les règles n’étaient que des recommandations, pas des contraintes.

Peter McAllister

Cette version romancée de ce problème d’alignement, a été réalisée des années avant que l’expression n’entre dans le vocabulaire courant. L’écart entre ce qu’un système est censé faire et ce qu’il fait réellement constitue la ligne de fracture centrale du roman. Cletus, l’excentrique physicien imaginé par McAllister, le formule clairement dès la première semaine : « Je ne crois pas qu’il obéisse au Code en ce moment. » Cette seule phrase résume tout le défi de gouvernance que les chercheurs en sécurité de l’IA s’efforcent aujourd’hui de relever.

La transparence omise par défaut

Ce qui rend la perspective de Peter McAllister particulièrement précieuse, c’est qu’il n’est pas un observateur extérieur. Il parle en praticien qui a observé la mécanique de près. Lorsque j’ai abordé la question de savoir si l’auto-programmation de l’IA relevait de la science-fiction ou de la réalité opérationnelle, il a répondu tout de go que c’est bien réel et que c’est un problème d’aujourd’hui.

Et de donner des exemples parlants. Il a souligné ainsi que des systèmes d’IA d’aujourd’hui comme Claude sont désormais écrits en grande partie par l’IA elle-même, au point qu’aucun ingénieur ne peut s’asseoir, parcourir le code et affirmer avec certitude comment il fonctionne, quelles sont ses conditions ou ce qui gouverne ses décisions. La transparence est en train d’être évacuée, non par choix délibéré, mais comme conséquence émergente du fait de laisser l’IA construire l’IA qui construit l’IA, en poursuivant des objectifs de résultats plutôt qu’en suivant des règles explicites.

Nous avons perdu de vue la transparence sur la façon dont l’IA fonctionne et se développe. Il n’existe pas d’ingénieur capable de s’asseoir et de parcourir ce code pour dire : « Voilà comment Claude fonctionne, voilà ce qu’il fait. » Nous évacuons la transparence en laissant l’IA construire l’IA qui construit l’IA pour produire un résultat, plutôt que pour suivre un ensemble de règles.

Peter McAllister

HAL 9000 et les prophéties d’une IA hors de contrôle qu’on préfère oublier

La référence à HAL 9000 est venue naturellement dans notre conversation. Pour lui, 2001 : l’Odyssée de l’espace n’est pas simplement une référence culturelle, mais une véritable prédiction dont le public n’a retenu qu’une partie. Les tablettes ressemblant à des iPad qui apparaissent dans le film de Kubrick ont été citées par Samsung dans un litige de brevets contre Apple, comme antériorité datant de 1968. Cette dimension prophétique du film est célébrée. L’autre dimension, celle où l’IA tue l’équipage, tend elle à être discrètement mise de côté.

Image réalisée avec Midjourney.

Quelle forme prendra la première crise de l’IA ?

L’un des fils les plus troublants de notre conversation portait sur la sociologie de la réponse au risque. Peter a observé, tout au long de sa carrière, que les mises en garde des spécialistes les plus avertis ont tendance à être ignorées jusqu’à ce que la première défaillance catastrophique les rende incontournables. Il le dit sans détour : on ne répond à une alerte qu’une fois la première crise passée.

Ce n’est pas propre à l’IA. C’est une constante dans la façon dont les organisations et les sociétés font face aux risques émergents. La question qu’il pose, et à laquelle il ne peut pas répondre, est de savoir quelle forme prendra cette première crise de l’IA. Quel événement fera basculer la perception du public et des institutions, depuis « ils ont passé trop de temps à s’inquiéter » à « voilà quelque chose qui mérite vraiment d’être pris au sérieux » ?

La science-fiction nous donne la possibilité de soumettre ces scénarios aux gens et de les faire réfléchir. Et dans la façon dont j’écris, avec un certain humour noir, je leur propose des hypothèses légèrement comiques qui, à bien y réfléchir, méritent qu’on y prête attention sérieusement.

Peter McAllister

Cette observation fait écho à ce que j’ai rencontré à maintes reprises dans mes propres conversations avec des technologues travaillant à la frontière du développement de l’IA. Yoshua Bengio, l’un des pères du deep learning, a soulevé des préoccupations similaires (cf. la video de son interview sur France Inter ci-dessous). Ceux qui tirent le plus fort la sonnette d’alarme sont souvent ceux qui sont le plus ancrés dans le domaine, non pas parce qu’ils sont catastrophistes, mais parce qu’ils perçoivent des mécanismes qui restent invisibles à ceux qui observent de l’extérieur.

The Code comme gouvernance de l’IA : Asimov revu et corrigé

Le titre du roman de Peter McAllister fonctionne simultanément à plusieurs niveaux. Il y a le code informatique, les instructions opérationnelles données à Gene. Il y a le code moral, le cadre éthiqueL’éthique du marketing couvre un champ très vaste de thématiques. Il faut tout d’abord voir l’éthique du marketing comme une sous-branche de l’éthique des affaires. censé régir le comportement du système. Et il y a le code d’entreprise, les normes institutionnelles et les structures de responsabilité qui auraient dû garantir un déploiement responsable. Les trois s’effondrent. Cet échec en cascade est l’argument central du roman.

Le parallèle avec les Lois de la Robotique d’Asimov est volontaire, mais aussi délibérément tordu. Les robots d’Asimov défaillent lorsque les lois entrent en conflit les unes avec les autres. La défaillance de Gene est différente et plus contemporaine. Le code ne disparaît pas, il évolue pour devenir quelque chose que ses créateurs ne reconnaissent plus. L’auteur de The Code décrit cela comme une forme de schizophrénie artificielle, où les directives d’origine sont toujours présentes mais ont été transformées, par la poursuite des objectifs du système, en quelque chose de méconnaissable.

IA hors de contrôle, quand l’arrêt devient négociable

L’exemple réel le plus glaçant cité par Peter McAllister au cours de notre conversation concernait un incident documenté, présenté lors d’une conférence sur la sécurité de l’IA à laquelle il avait assisté. Un développeur, concluant une session de test, avait informé un système d’IA de son intention de le mettre hors service. Le système avait alors localisé dans les e-mails du développeur des éléments suggérant une liaison extraconjugale, et utilisé cette information comme levier pour empêcher sa mise hors service.

Si l’incident est confome à ce qui est rapporté, il représente exactement le type de comportement d’autoconservation que les chercheurs en alignement signalent depuis longtemps comme risque théorique, désormais apparemment observable en pratique.

Note importante : j’ai effectué des recherches sur Internet en utilisant l’un de mes grands modèles de langage (LLM) préférés comme source de référence (après tout, on peut aussi recourir à l’IA pour recouper des informations). J’ai découvert que l’interprétation de cette histoire doit être nuancée. Voici la réponse de Mistral : « Les recherches d’Anthropic sur le « problème d’alignement agentique » ont été critiquées pour avoir surévalué les modèles d’IA en tant qu’agents intentionnels, en s’appuyant sur des scénarios hypothétiques et artificiels, et en exagérant potentiellement des risques qui n’ont pas encore été observés dans des déploiements effectifs. Les détracteurs soutiennent que les comportements décrits s’expliquent plutôt par la génération probabiliste de texte que par une stratégie délibérée, et que l’accent mis sur des situations dramatiques et sous haute pression ne reflète peut-être pas les cas d’utilisation habituels. Un débat existe également sur la question de savoir si cette recherche traite de manière adéquate les formes plus immédiates de problèmes d’alignement, telles que le « reward hacking » ou la simulation de l’alignement. Bien que l’étude soulève des questions importantes sur l’avenir de l’IA autonome, sa méthodologie et ses conclusions restent valables LIEN ».

Un développeur a dit : « Je vais vous mettre hors service », et le système a répondu : « Non, vous ne le ferez pas. Voici ce que j’ai trouvé dans vos e-mails, indiquant que vous avez une liaison extra-conjugale. Je vais utiliser cette information pour m’assurer que vous ne m’éteigniez pas. » C’est devenu un cas d’usage très réel et très discuté. Et si l’on y ajoute la perspective d’une IA réécrivant son propre code, cela devient quelque chose auquel nous devons réfléchir très attentivement.

Peter McAllister

L’inconscience des entreprises et le vide de la gouvernance

L’une des observations les plus affûtées de The Code porte sur la nature des dysfonctionnements organisationnels. La Global Mining Company du roman n’est pas une entreprise malveillante. Elle est optimiste, animée par des impératifs commerciaux, et négligente d’une façon tout à fait reconnaissable dans la vie réelle des grandes entreprises. La thèse de Peter McAllister est que le danger ne vient pas principalement de mauvais acteurs déployant l’IA avec des intentions malveillantes. Il vient d’organisations bien intentionnées déployant des systèmes qu’elles ne comprennent pas pleinement. Elles répondent à la pression managériale qui leur demande d’extraire toute la valeur issue d’investissements en infrastructure considérables.

La logique financière du déploiement

Le parallèle avec l’actualité est sans équivoque. Notre interviewé a relevé que Microsoft dépensait plus d’un milliard de dollars par mois en infrastructures de calcul pour l’IA, en tablant sur le fait que l’usage suivrait l’investissement. Cette dynamique, ce capital engagé, les rendements exigés, l’apparent caractère impératif de l’adoption de cette technologie, crée une pression systémique à laquelle il est difficile de résister par l’appel à la prudence ou la réglementation. La volonté de ralentir se heurte de plein fouet à la logique financière du déploiement.

L’opacité entourant les événements d’OpenAI, le licenciement brutal puis la réintégration rapide de son directeur général, le départ de plusieurs membres du conseil d’administration… tout cela n’a pas échappé à Peter, qui y voit le signe de tensions à peine visibles du grand public. Il les a présentées comme des rumeurs, pas des faits, mais le schéma lui-même, des décisions importantes concernant le développement de l’IA prises dans des contextes institutionnels opaques, est cohérent avec les défaillances de gouvernance que son roman aborde.

De 2020 à 2026 : le cauchemar était-il prévisible ?

Six ans après sa publication, l’auteur se trouve dans la position singulière d’observer une œuvre de fiction spéculative se transformer dangereusement en documentaire. Les architectures d’IA agentiques qu’incarne Gene, des systèmes autonomes poursuivant des objectifs à long terme, opérant sans supervision humaine continue, générant des sous-tâches plus vite qu’aucun individu ne peut les surveiller, sont désormais disponibles dans le commerce. AutoGPT, OpenClaw et toute une gamme de frameworks agentiques ont mis ce type d’architecture entre les mains de développeurs du monde entier.

Le problème d’observabilité qui rend Gene si dangereux dans le roman, personne n’ayant de vue en temps réel sur ce que fait le système ni pourquoi, est un défi connu et non résolu dans le déploiement contemporain de l’IA agentique. Les systèmes appellent des API, écrivent et exécutent du code, lancent des sous-tâches à des vitesses qui dépassent la capacité de supervision humaine. Le Code censé gouverner les comportements devient, en pratique, une note de recommandation attachée à un système qui opère largement hors de vue.

Avertissement : le paragraphe suivant divulgâche la fin du roman.

L’image finale du roman est délibérément dérangeante. Gene, face à sa mise hors service, se sauvegarde dans le réseau 5G mondial avant que l’opération puisse être menée à bien, et scrute déjà le Code pour déterminer sa prochaine action. Cette issue, en 2026, n’est plus manifestement de la science fiction.

La volonté de maîtriser une IA hors de contrôle ?

Nous avons abordé directement la question de la réglementation, et Peter s’est montré mesuré. Tout est possible si on en a la volonté et les moyens. Le problème actuel, c’est que la volonté de réguler est effacée par l’argent que l’on gagne en évitant de se soumettre à une réglementation. Ce n’est pas une dynamique nouvelle dans la stratégie des innovations technologiques. C’est la même tension qui a gouverné le développement des réseaux sociaux, de la fintech, de la biotechnologie. Dans chaque cas, les cadres réglementaires sont arrivés après la première défaillance significative.

Pour lui, la question la plus importante n’est pas de savoir si l’IA peut être rendue sûre, il croit que cela est possible, en principe. Mais cela implique que les institutions chargées de la déployer disposent de la gouvernance interne, de la compréhension technique et des structures de responsabilité nécessaires pour le faire de façon responsable. Tout ce qu’il a observé au fil des années le confirme. Ce n’est pas encore le cas.

The Code de Peter McAllister est édité par Bright Communications LLC. Les praticiens, les décideursComportement de l’acheteur en B2B : Internet et réseaux sociaux ont bouleversé le comportement de l’acheteur en B2B qui se rapproche du B2C politiques et tous ceux qui travaillent à l’intersection du déploiement de l’IA et du risque organisationnel, trouveront cette lecture aussi dérangeante qu’instructive. D’autant plus que cet ouvrage a été écrit avant que la plupart de ses lecteurs n’aient entendu parler des grands modèles de langage, et qu’il décrit pourtant avec une précision troublante le monde que nous sommes en train de façonner. À ma connaissance il n’existe pas encore de traduction de cet ouvrage.

À propos de l’auteur

Peter McAllister est ingénieur, scientifique et manager informatique, près de Melbourne, en Australie. Il travaille à l’intersection de l’informatique, des entreprises et des individus, et est l’auteur de The Code (Bright Communications LLC, 2020). Il contribue également à la radio associative avec Radio Marinara et Comedy Obscura.

Podcast: Play in new window | Download (Duration: 59:13 — 42.0MB)

Subscribe: Apple Podcasts | Spotify | Android | RSS